La frase latina “Quod natura non dat, Salmantica non praestat” ha sido reinterpretada en la era digital como “Quod natura non dat, artificialis intelligentia non praestat”, lo que se traduce en que lo que la naturaleza no otorga, la inteligencia artificial (IA) tampoco puede proporcionar. Esta reflexión invita a pensar acerca de los límites de las tecnologías emergentes, especialmente los modelos de lenguaje grandes y sistemas inteligentes, y resalta la importancia insustituible de la inteligencia humana natural. En un mundo en el cual la inteligencia artificial parece expandirse a un ritmo vertiginoso, es tentador creer que estas herramientas pueden suplir cualquier carencia o limitación humana. Sin embargo, a pesar de sus asombrosas capacidades, la IA se basa en algoritmos y datos preexistentes que reflejan y amplifican el conocimiento y habilidades humanos, pero no pueden crear de la nada capacidades innatas como la memoria, la capacidad de comprensión profunda, el razonamiento complejo o la creatividad auténtica. La Universidad de Salamanca, uno de los centros educativos más antiguos y prestigiosos de Europa, inmortalizó esta idea en una inscripción en piedra que declara que no se puede compensar lo que la naturaleza no otorga.

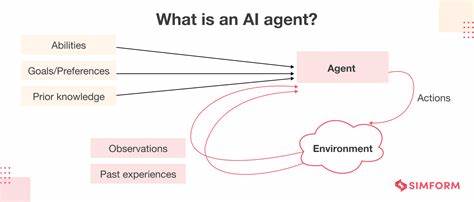

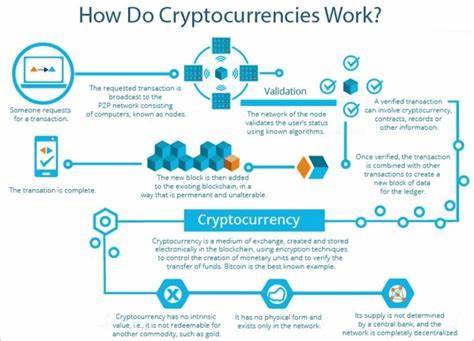

La analogía es perfectamente aplicable a la inteligencia artificial: aunque estas herramientas sean poderosas, no pueden reemplazar el talento, la curiosidad, la motivación y el juicio crítico humanos necesarios para el aprendizaje y la toma de decisiones. De hecho, la inteligencia artificial puede ser vista como una extensión o complemento de las capacidades humanas, pero siempre requiere un operario capacitado para su correcta utilización. La capacidad para formular preguntas acertadas, interpretar las respuestas, detectar información errónea o sesgada y aplicar el conocimiento en situaciones prácticas sigue siendo una función profundamente humana e insustituible por cualquier algoritmo. Uno de los aspectos más fascinantes y a la vez desafiantes en el uso de modelos de lenguaje grandes (LLMs), como ChatGPT, es el arte del diseño de indicaciones o “prompt engineering”. Este proceso se ha vuelto fundamental para obtener resultados pertinentes y útiles.

Una buena indicación incluye contexto, ejemplos y mensajes claros que guíen a la IA para que brinde respuestas más cercanas a lo que el usuario necesita. En cierto sentido, quienes logran esta habilidad son verdaderos magos modernos, capaces de “hipnotizar” a la máquina para que actúe en concordancia con las expectativas. Pero esta hipnosis artificial tiene límites y riesgos. Los modelos de lenguaje pueden generar información incorrecta, conocida como “alucinaciones”. Por eso, la interpretación humana para validar, contrastar y cuestionar las respuestas es crucial.

Una dependencia ciega en estas tecnologías sin capacidad crítica puede llevar a la desinformación y a decisiones erradas con consecuencias potencialmente peligrosas. Es importante reconocer que la inteligencia, la memoria y la comprensión son habilidades que requieren cultivo diario, como si se tratara de una rutina en el gimnasio. Delegar estas tareas en la inteligencia artificial sin entrenamiento previo equivale a perder la capacidad de pensar de manera independiente, debilitando gradualmente la facultad para discernir, analizar y sintetizar información. Ya hay ejemplos evidentes en la sociedad donde la dependencia excesiva de la tecnología ha provocado una disminución en algunas habilidades cognitivas básicas. Además, el aprendizaje profundo de un tema es condición necesaria para aprovechar al máximo los beneficios de la IA.

Sin un conocimiento previo sólido, las respuestas generadas por los sistemas inteligentes pueden parecer convincentes pero carecerán de sustancia o serán incorrectas. Por ello, el uso efectivo de la inteligencia artificial requiere tanto dominio técnico como dominio del contenido específico. En la medida en que los modelos de lenguaje evolucionan, la complejidad y sutileza para diseñar y entender las indicaciones aumenta. Esta evolución podría propiciar nuevas profesiones y especializaciones enfocadas en maximizar el potencial de la IA, tales como los especialistas en ‘IA sugestiva’ o ‘hipnotistas de modelos de lenguaje’. Estos expertos combinarían habilidades técnicas con una comprensión psicológica para guiar la interacción entre humanos y máquinas de forma más eficiente y segura.

En definitiva, la inteligencia artificial es una herramienta poderosa y prometedora, pero su utilidad y seguridad dependen enteramente de la inteligencia natural que la utiliza. El escepticismo saludable, la capacitación continua y el desarrollo personal son la base para que las tecnologías no reemplacen sino potencien la capacidad humana. La modernidad nos ofrece un arsenal tecnológico sin precedentes, sin embargo, lo esencial permanece: no hay sustituto para la inteligencia natural, la reflexión profunda y el juicio crítico. La frase adaptada “Quod natura non dat, artificialis intelligentia non praestat” sigue siendo un recordatorio vigente del valor irreemplazable de lo humano en la era digital.