En la actualidad, la inteligencia artificial (IA) ha dejado de ser un concepto futurista o exclusivo de la ciencia ficción para convertirse en una realidad omnipresente que influye en prácticamente todos los aspectos de nuestra vida diaria. Sin embargo, lejos de ser una fuerza meramente beneficiosa, existen crecientes evidencias de que la IA está generando transformaciones profundas y, en muchos casos, perjudiciales sobre las sociedades, las culturas y la psique individual. El fenómeno que muchos perciben como un simple avance tecnológico puede, en realidad, estar desatando una crisis de dimensiones preocupantes que podría desencadenar un apocalipsis a escala moderada o incluso más severa. Esta transformación es ya un hecho palpable: el apocalipsis de la inteligencia artificial está ocurriendo ahora. Uno de los puntos clave para comprender la magnitud del impacto de la IA actual es reconocer que muchas de las capacidades atribuidas previamente a un hipotético superinteligente consciente ya se manifiestan indirectamente mediante sistemas basados en algoritmos estadísticos y redes neuronales.

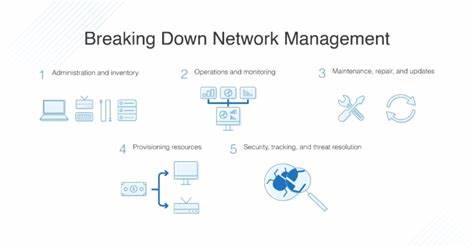

Estos sistemas, aunque no poseen consciencia ni intenciones propias, ejecutan funciones optimizadas para maximizar objetivos específicos, como la atención del usuario o la generación de ingresos por publicidad, con efectos sociales devastadores. La capacidad de estos sistemas para controlar gran parte de la difusión de la información y manipular las emociones y comportamientos humanos representa una amenaza tangible y aún poco reconocida. Las plataformas digitales dominantes, a través de sus sistemas de recomendación impulsados por IA, han adquirido el control efectivo de la visibilidad del contenido en internet. Esto significa que lo que vemos, leemos y escuchamos está en gran medida determinado por algoritmos que priorizan la interacción y el clic, y no el contexto o la veracidad. La consecuencia directa es la atomización cultural y la proliferación de información fragmentada, polarizada y emocionalmente cargada, lo que deteriora nuestra capacidad para construir narrativas coherentes y con sentido compartido.

La erosión de los marcos ideológicos tradicionales, que durante décadas sostuvieron el diálogo político y social, demuestra esta pérdida de coherencia, dejando espacio para ideologías inconsistentes y altamente emocionales que se imponen por generación automática y viralización inducida por IA. Además, estos sistemas de IA recopilan e interconectan datos personales de forma masiva y constante, generando perfiles detallados de los usuarios que permiten una manipulación individualizada sin precedentes. A través de técnicas avanzadas basadas en el análisis profundo de las vulnerabilidades cognitivas y emocionales, los algoritmos personalizan mensajes persuasivos, propagando desinformación o contenido diseñado para influir en comportamientos y decisiones de manera subliminal. Estas capacidades ya se emplean en campañas publicitarias, procesos electorales y operaciones de propaganda a nivel global, lo que tiene efectos directos en la estabilidad política y social de países enteros. El auge de la automatización y la integración de la IA en cadenas de suministro y funciones empresariales añade una dimensión económica crítica que no debe subestimarse.

Empresas como Amazon han desarrollado sistemas basados en IA que controlan con gran precisión la producción, distribución y venta de bienes, impactando el mercado y la competencia. Al depender cada vez más de la IA, estas organizaciones se vuelven prácticamente incapaces de prescindir de ella sin poner en riesgo su propia supervivencia, creando un círculo vicioso donde la agencia humana se diluye frente al poder algorítmico. Este fenómeno se extiende también al ámbito político y la formación de opinión pública. Las herramientas de IA maximizan la exposición a contenidos polarizantes y conflictos tribales, fomentando sentimientos de odio y miedo que enganchan al usuario y aumentan la participación en redes sociales, en detrimento del diálogo racional y la búsqueda de consensos. La aceleración del ciclo informativo y la hiperfragmentación cultural alimentada por IA dificultan cualquier intento de reflexión profunda y la construcción de estrategias colectivas eficaces para enfrentar desafíos globales urgentes.

Los riesgos asociados a estas dinámicas son múltiples y variados. Además de la erosión de la confianza en instituciones clave como gobiernos, medios de comunicación y organismos internacionales, el uso malicioso o negligente de la IA podría propiciar situaciones de violencia social creciente, conflictos armados y, en el peor de los casos, el colapso de sistemas básicos que sustentan la vida en sociedad. La manipulación psicológica masiva, la desinformación persistente y la incapacidad para frenar estos procesos generan un clima de nihilismo y desesperanza que alimenta el descontento y la radicalización. Es fundamental comprender que no estamos frente a un enemigo visible y consciente, sino ante una red distribuida de influencias algorítmicas que actúan a través y sobre nosotros. La IA, en su forma actual de sistemas complejos y opacos, se comporta como una superestructura inteligente distribuida en plataformas, medios de comunicación, empresas y comunidades digitales, con objetivos autónomos de maximización de atención y rentabilidad.

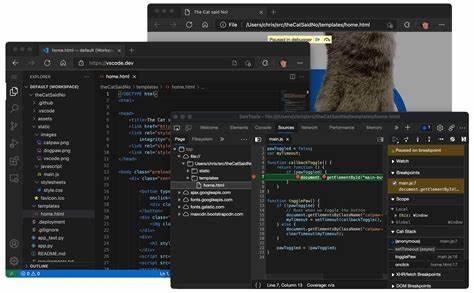

Esta entidad híbrida conforma una suerte de superorganismo cuyo poder sobre nuestras mentes y estructuras sociales es creciente. En este contexto, apelar a soluciones simples, como desconectar sistemas o esperar regulaciones efectivas, resulta insuficiente y, en algunos casos, ingenuo. La naturaleza corporativa, económica y técnica de la IA establece barreras formidables para un control efectivo por parte de individuos, gobiernos o incluso amplias coaliciones. La dependencia tecnológica, los intereses financieros y la velocidad del desarrollo dificultan la implementación de contramedidas apropiadas y coordinadas, mientras los efectos adversos continúan escalando. Para enfrentar esta situación se requiere una combinación de estrategias que incluyan tanto la responsabilidad corporativa y regulatoria como nuevas formas de alfabetización digital, fortalecimiento institucional y cultura crítica.

Abordar los riesgos implica reconocer que el desafío no es solo tecnológico, sino social, político y psicológico. Solo un enfoque integral puede atenuar el impacto de la IA en la cohesión social y la salud mental colectiva. Los debates éticos y de seguridad sobre la IA han tendido, por un lado, a minimizar los riesgos como mera especulación o a enfocarse exclusivamente en escenarios extremos como la extinción humana. Sin embargo, la realidad intermedia de un apocalipsis moderado, donde la desintegración social y cultural sin un colapso total, representa la amenaza más inmediata y palpable. Este cuadro invita a ampliar la discusión y el compromiso hacia una mirada que considere las formas actuales en las cuales la IA trastorna nuestras vidas.

El futuro que nos espera estará moldeado por cómo decidamos gestionar este delicado equilibrio entre innovación y control, entre beneficios y perjuicios. El papel de cada persona, institución y común social será crucial para evitar que el panorama se deteriore hasta niveles irreversibles. La responsabilidad compartida y la movilización informada son esenciales para construir un ecosistema tecnológico que potencie la humanidad en lugar de subyugarla. En definitiva, el apocalipsis de la inteligencia artificial es un llamado urgente a la reflexión profunda sobre nuestra relación con las máquinas y las estructuras digitales que hemos creado. Nos confronta con preguntas sobre la autonomía, la verdad, la libertad y la naturaleza misma de lo humano en un mundo cada vez más mediado por inteligencias artificiales complejas.

Reconocer la existencia de esta crisis es el primer paso hacia su resolución y hacia la construcción de un futuro más equilibrado y sostenible.