Apple ha dado un paso firme en su compromiso con la inclusión y accesibilidad al anunciar una amplia gama de funciones avanzadas que estarán disponibles más adelante en 2025. Estas novedades permiten a personas con diversas discapacidades interactuar con la tecnología de manera más sencilla, segura y personalizada, haciendo que cada usuario pueda aprovechar al máximo sus dispositivos Apple. La apuesta de Apple por incorporar la accesibilidad dentro de su ADN tecnológico se plasma en características que aprovechan el poder de los procesadores Apple silicon, además de innovaciones en aprendizaje automático y inteligencia artificial, posicionando a la compañía a la vanguardia para brindar una experiencia verdaderamente inclusiva. Una de las grandes novedades es la introducción de las Etiquetas de Nutrición de Accesibilidad en la App Store, un recurso diseñado para ofrecer a los usuarios una visión más clara y detallada de las características accesibles que ofrecen las aplicaciones y juegos antes de su descarga. Este avance es de gran utilidad para personas con discapacidad visual o motriz, ya que ahora pueden tomar decisiones informadas sobre la compatibilidad de las apps con sus necesidades.

Las etiquetas incluyen información sobre soporte para VoiceOver, control por voz, textos más grandes, contraste suficiente, reducción de movimiento, subtítulos y mucho más. Además, se brinda a los desarrolladores una guía clara para comunicar claramente las particularidades accesibles de sus productos, fomentando un ecosistema más inclusivo y transparente. El Magnificador llega ahora al Mac, extendiendo una herramienta invaluable que desde 2016 ha estado disponible en iPhone y iPad. Esta aplicación conecta con las cámaras del dispositivo o con cámaras externas, incluyendo la función Continuity Camera de iPhone, para ampliar y facilitar la visualización de textos, objetos y entornos físicos a personas con baja visión. Ofrece además la posibilidad de gestionar varias sesiones activas simultáneamente, permitiendo, por ejemplo, que el usuario siga una presentación por webcam mientras lee un libro al mismo tiempo mediante la función Desk View.

La personalización es un factor clave, ya que se pueden ajustar brillo, contraste, filtros de color e incluso la perspectiva para optimizar la legibilidad. Asimismo, se pueden capturar y guardar diversas vistas para su revisión posterior, maximizando la productividad y la autonomía. En conjunto con el Magnificador, Apple introduce la función Accessibility Reader, un modo de lectura avanzado disponible en iPhone, iPad, Mac y Apple Vision Pro. Esta herramienta está pensada para personas con dificultades de lectura, tales como dislexia o baja visión, ofreciendo una variedad de opciones de personalización en fuentes, colores y espaciados. Al soportar además contenido hablado, permite que el texto seleccionado sea leído en voz alta, facilitando así la comprensión y el acceso a la información.

Accessibility Reader se puede activar desde cualquier aplicación, lo que garantiza una experiencia uniforme en todo el sistema. El ecosistema Apple se expande aún más con una experiencia renovada para usuarios de Braille. Braille Access transforma el iPhone, iPad, Mac y Apple Vision Pro en un potente dispositivo para tomar notas en braille y realizar cálculos usando el código Nemeth, frecuente en entornos educativos de ciencias y matemáticas. Con un lanzador de aplicaciones integrado, los usuarios pueden acceder a cualquier aplicación simplemente tecleando mediante un dispositivo braille conectado. Igualmente, la compatibilidad con archivos en formato Braille Ready Format (BRF) facilita el acceso a una amplia biblioteca de documentos accesibles.

Una función adicional permite transcribir conversaciones en tiempo real en las pantallas braille, utilizando una versión integrada de Live Captions, lo que favorece la comunicación instantánea y fluida. En el ámbito auditivo, Apple introduce importantes mejoras en Live Listen, que ahora llega a Apple Watch. Esta tecnología convierte el iPhone en un micrófono remoto para retransmitir el audio directamente a AirPods, audífonos compatibles Made for iPhone o auriculares Beats. La novedad radica en que las personas pueden visualizar en tiempo real las transcripciones de lo que capta el iPhone a través de su Apple Watch. Esta función resulta especialmente útil en entornos de clase o reuniones, pues permite controlar las sesiones a distancia y revisar partes del audio que se pudieron haber perdido sin interrumpir la actividad.

Además, Live Listen complementa las funcionalidades auditivas avanzadas presentes en los AirPods Pro de segunda generación, que cuentan con un modo de audífono clínico. Los usuarios de Apple Vision Pro también recibirán sustanciales actualizaciones en visiónOS que utilizan la avanzada cámara principal del dispositivo para potenciar la accesibilidad visual. La función Zoom ofrece la posibilidad de ampliar cualquier elemento en vista, desde textos hasta el entorno físico, facilitando un mayor nivel de interacción y comprensión para personas con baja visión. Live Recognition emplea aprendizaje automático directamente en el dispositivo para describir el entorno, identificar objetos y leer documentos, haciendo más autónoma la experiencia para usuarios con discapacidad visual. Además, Apple pone a disposición una nueva API para desarrolladores de accesibilidad, permitiendo que aplicaciones aprobadas accedan a la cámara principal para ofrecer asistencia visual en tiempo real, ejemplificado en servicios como Be My Eyes, que proporciona ayuda visual a distancia.

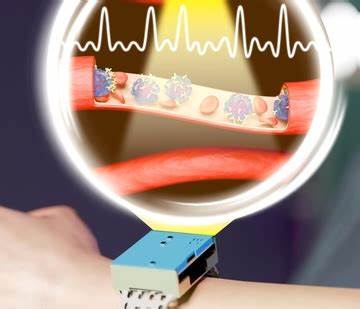

Otros avances relevantes incluyen la ampliación y personalización de sonidos de fondo para mejorar la concentración y relajación, especialmente para usuarios que sufren de tinnitus. La función Personal Voice, orientada a personas en riesgo de perder la capacidad de hablar, se ha mejorado para ofrecer una creación rápida y natural de voces personalizadas mediante inteligencia artificial y aprendizaje automático, requiriendo apenas 10 frases grabadas. Además, se incorpora soporte idiomático para español (México), ampliando su alcance cultural. Para los usuarios con movilidad limitada, Apple presenta soporte para interfaces cerebrales (BCI), una tecnología emergente que permite controlar dispositivos sin necesidad de movimientos físicos. Esto abre un nuevo horizonte para las personas con discapacidades severas, facilitando la comunicación y control de tecnología mediante pensamientos y comandos cerebrales.

Las innovaciones también tocan sectores como CarPlay, que ahora soporta texto de gran tamaño para mejorar la legibilidad en el vehículo, y detección mejorada de sonidos importantes, como el llanto de un bebé o sirenas, ofreciendo alertas para quienes tienen discapacidades auditivas. La sincronización de vocabulario en Control por Voz entre dispositivos y la inclusión de nuevos idiomas aportan mayor flexibilidad y personalización. Apple complementa estas funciones con iniciativas educativas y de concientización. En sus tiendas, durante el mes de mayo, se habilitan mesas dedicadas a mostrar dispositivos con características accesibles, y se ofrecen sesiones anuales de aprendizaje y personalización para usuarios que deseen profundizar en cómo adaptar sus productos a sus necesidades. Simultáneamente, Apple Music, Apple TV+, Apple Books y otros servicios de la compañía destacan contenidos que celebran la diversidad y contribuyen a visibilizar comunidades con discapacidades.

La suma de estas funcionalidades refleja la profunda convicción de Apple de que la tecnología debe ser accesible para todos, sin importar limitaciones físicas o sensoriales. Al integrar inteligencia artificial, aprendizaje automático y hardware avanzado, Apple no solo mejora la vida cotidiana de las personas con discapacidades, sino que también marca un estándar en la industria tecnológica para hacer de la accesibilidad un pilar esencial. En conclusión, el lanzamiento de estas potentes funciones de accesibilidad en 2025 reafirma el compromiso de Apple con la inclusión digital y la innovación centrada en el usuario. Con herramientas como Magnificador para Mac, Braille Access, Accessibility Reader, y avances significativos en Live Listen y visionOS, el ecosistema Apple se posiciona como un referente global para la tecnología accesible, dignificando y empoderando a millones de usuarios alrededor del mundo.