En un mundo cada vez más digitalizado, las criptomonedas han ganado popularidad, no solo como una alternativa de inversión, sino también como un medio para facilitar transacciones rápidas y anónimas. Sin embargo, este auge también ha atraído la atención de actores maliciosos que buscan aprovecharse de los sistemas de seguridad, especialmente a través de técnicas avanzadas como los deepfakes. Un reciente informe de Cato Networks reveló cómo los deepfakes pueden eludir los sistemas de reconocimiento facial en las plataformas de intercambio de criptomonedas, lo que plantea serias preocupaciones sobre la seguridad y la integridad de estas plataformas. Los deepfakes son una forma de inteligencia artificial que permite crear videos y audios falsos que pueden parecer sorprendentemente reales. Esta tecnología, si bien tiene aplicaciones creativas y legítimas, también se ha convertido en una herramienta poderosa para los defraudadores.

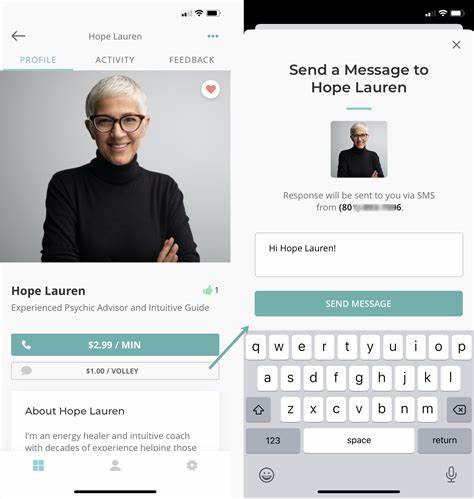

En particular, un individuo conocido en la dark web como ProKYC ha comenzado a ofrecer un software que utiliza deepfakes para falsificar identificaciones gubernamentales y engañar a los sistemas de reconocimiento facial de diversas plataformas de intercambio de criptomonedas. El proceso es bastante ingenioso y peligroso. Las plataformas de intercambio, que buscan garantizar que sus usuarios sean quienes dicen ser, suelen requerir que los nuevos usuarios proporcionen una identificación válida, como un pasaporte o una licencia de conducir, además de aparecer en un video en tiempo real. En el caso de ProKYC, el atacante utiliza herramientas de inteligencia artificial para generar una imagen de una persona ficticia que luego se coloca en un documento de identidad falso. Al mismo tiempo, el software de deepfake simula el movimiento del rostro de la persona generada, creando un video que parece cumplir con los requisitos de reconocimiento facial de la plataforma.

Este tipo de fraude, conocido como "New Account Fraud" (fraude de nueva cuenta), ha cobrado protagonismo en los últimos años y ha llevado a pérdidas significativas; Javelin Research y AARP reportaron en 2023 unas pérdidas de 5.3 mil millones de dólares relacionadas con este tipo de actividades fraudulentas. Las implicancias están claras: los atacantes pueden crear cuentas en las que lavan dinero obtenido de actividades ilegales, lo que exacerba aún más los problemas que enfrentan las autoridades en la lucha contra el lavado de dinero y otros delitos financieros. Además del impacto económico, el uso de deepfakes en el ámbito de las criptomonedas puede contribuir a un entorno en el que se vuelve más difícil distinguir entre lo real y lo falso. Esto no solo afecta a las plataformas de intercambio, sino que también puede llevar a una mayor desconfianza entre los usuarios y las instituciones que regulan el sector financiero.

Ante estas amenazas, las plataformas de intercambio deben adoptar medidas proactivas para protegerse contra el fraude. Cato Networks, a través de la experiencia de su estratega de seguridad, Etay Maor, ha recomendado varias estrategias que pueden ayudar a las empresas a identificar y prevenir la creación de cuentas falsas utilizando tecnologías de deepfake. Una de las recomendaciones clave es estar alerta a las características comunes de los videos generados por inteligencia artificial. Los deepfakes tienden a ser de una calidad extraordinaria que puede diferir de las grabaciones típicas de una webcam. Por ejemplo, los sistemas de reconocimiento deben estar preparados para detectar irregularidades en áreas críticas del rostro, como los ojos y los labios, donde los deepfakes aún pueden presentar inconsistencias.

Otra estrategia importante es la recopilación de datos de inteligencia sobre amenazas. Esto implica que las empresas deben estar al tanto de las nuevas herramientas y métodos que los atacantes pueden utilizar, lo cual requiere un enfoque colaborativo entre diferentes sectores para compartir información valiosa. El equilibrio entre la rigurosidad y la facilidad de acceso a las plataformas es un desafío constante; un sistema de autenticación excesivamente restrictivo puede dar lugar a numerosos falsos positivos, mientras que una falta de controles adecuados puede abrir la puerta a más fraudes. La implementación de autentificación de múltiples factores, junto con tecnología que puede identificar patrones anómalos en el uso de las cuentas, puede ser vital para contrarrestar estos ataques. A medida que la calidad de los deepfakes mejora, también lo hacen las técnicas de detección.

Los avances tecnológicos en el aprendizaje automático y la inteligencia artificial están comenzando a ofrecer soluciones que pueden distinguir entre videos reales y falsos con un grado cada vez mayor de precisión. Sin embargo, la protección no recae únicamente sobre las plataformas de intercambio. Los usuarios también tienen un papel fundamental en la defensa contra el fraude. La educación sobre los riesgos asociados con la creación de cuentas y las técnicas que utilizan los delincuentes es esencial. Los usuarios deben ser conscientes de cómo operar de manera segura en este espacio, manteniendo siempre un ojo crítico hacia cualquier solicitud sospechosa y las prácticas de seguridad de las plataformas con las que eligen interactuar.

En conclusión, el fenómeno de los deepfakes representa un desafío significativo para la seguridad de las plataformas de intercambio de criptomonedas. El potencial para la manipulación y el fraude ha llevado a un llamado urgente para que las empresas y los individuos se unan en la lucha contra esta tecnología maliciosa. La combinación de tecnología avanzada, educación y vigilancia constante será crucial para asegurar que el ecosistema de las criptomonedas siga siendo un espacio seguro y viable. A medida que avanzamos hacia un futuro donde la inteligencia artificial juega un papel cada vez más prominente, todos debemos ser conscientes de los riesgos y trabajar juntos para mitigar las amenazas que surgen en esta nueva era digital.