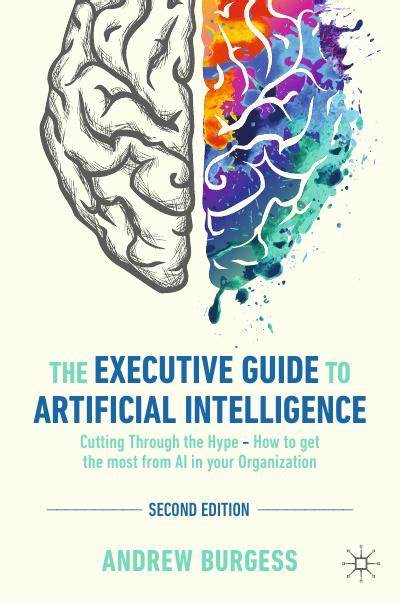

La inteligencia artificial (IA) ha emergido como uno de los desarrollos tecnológicos más significativos del siglo XXI, generando entusiasmo, expectativas y, también, una considerable cantidad de desinformación. En medio del ruido mediático, es fundamental contar con una guía que permita distinguir entre las promesas reales y el exagerado hype que a menudo rodea a estas tecnologías. La IA no es un ente mágico ni una solución mágica capaz de transformar todas las industrias instantáneamente; más bien, es una herramienta poderosa con limitaciones claras y contextos específicos para su correcto funcionamiento. Expertos como Arvind Narayanan y Melanie Mitchell, reconocidos investigadores en el campo, han ofrecido perspectivas críticas y esclarecedoras sobre el desarrollo actual y futuro de la IA, enfatizando la importancia de entender tanto las capacidades como las fragilidades que presentan estos sistemas. Uno de los aspectos más problemáticos del hype en IA es la percepción errónea de que estos sistemas «piensan» o «razonan» como los humanos.

Si bien los modelos de lenguaje avanzados, como ChatGPT, pueden generar textos fluidos y respuestas convincentes, carecen de conciencia, empatía o comprensión real. En esencia, estos modelos combinan patrones estadísticos a partir de grandes cantidades de datos, sin poseer una comprensión profunda ni una memoria experiencial continua. Esto limita su capacidad para aplicar sentido común o interpretar contextos de manera flexible. Un ejemplo claro que demuestra esta limitación es la dificultad que tienen las IA para coordinar tareas entre diferentes modalidades, como el procesamiento del lenguaje y la generación de imágenes. Por ejemplo, un chatbot puede asegurarte que una imagen generada no contiene un elefante, pero al no «ver» la imagen que produjo debido a arquitecturas técnicas separadas para cada función, comete errores básicos como incluir un elefante en una habitación donde se solicitó explícitamente que no estuviera.

Recientemente, la integración multimodal ha avanzado, y nuevos modelos están empezando a superar estas limitaciones, aunque el desafío sigue siendo considerable. La falta de metacognición en los sistemas de IA también es una barrera importante. A diferencia de los humanos, que poseen conciencia y reflexión sobre sus propios procesos de pensamiento, las actuales inteligencias artificiales no pueden evaluar la veracidad o la confianza en sus respuestas. Tampoco tienen una memoria episódica que les permita construir un conocimiento acumulado de sus experiencias previas. Esto implica que cada conversación o interacción inicia sin un contexto acumulado, dificultando la continuidad y la adaptación real a necesidades concretas.

En paralelo, la evaluación de la inteligencia artificial enfrenta lo que se ha denominado una crisis. Las pruebas tradicionales, como exámenes jurídicos o médicos, no representan la complejidad integral de estas profesiones en el mundo real. Aunque un modelo pueda superar un examen estandarizado, en la práctica puede generar información falsa, como citas inexistentes en documentos legales, lo que pone en riesgo la confiabilidad y la responsabilidad en su uso profesional. Este fenómeno muestra que la evaluación basada únicamente en benchmarks o pruebas puntuales resulta insuficiente para valorar el rendimiento real y la utilidad práctica de la IA. Desde una perspectiva estructural, uno de los problemas es que quienes desarrollan los sistemas son los mismos que los evalúan, creando un conflicto de interés y elevando el riesgo de sesgos y sobreestimaciones.

Por ello, se necesita con urgencia un sistema independiente y robusto de evaluación que permita analizar exhaustivamente los sistemas de IA de manera objetiva y transparente, similar a cómo la industria automotriz ha adoptado pruebas independientes de seguridad para sus vehículos. También es necesario un enfoque técnico renovado para la evaluación, que vaya más allá de la mejora de métricas aisladas y abarque aspectos multidimensionales, incluyendo la adaptabilidad, la transparencia, la equidad y la seguridad. La evaluación debe considerar tanto las capacidades generales como el desempeño en contextos específicos de uso, entendiendo que la efectividad de un modelo varía según la aplicación y el comportamiento de los usuarios. Respecto a las predicciones futuristas que aseguran que la IA reemplazará completamente a profesionales como médicos y docentes en unos pocos años, es vital mantener un escepticismo informado. La complejidad del trabajo humano, que demanda juicio contextual, empatía y habilidades interpersonales, queda lejos del alcance de la IA actual o incluso de la que se prevé a corto plazo.

El sobreoptimismo suele basarse en evaluaciones parciales y no en un análisis profundo de las múltiples facetas y habilidades que conforman dichas profesiones. Este fenómeno no es nuevo en la historia de la IA. En las décadas pasadas, sistemas expertos prometieron revolucionar áreas como la medicina o la educación, sin embargo, fracasaron por no captar el conocimiento tácito y contextos dinámicos que solo los humanos manejan. Por lo tanto, es prudente no tomar las predicciones futuristas con demasiada literalidad y cuestionar quiénes y con qué criterios las realizan. Otro punto crucial para desmitificar el hype es la desconexión creciente entre la comunidad de expertos en IA y el público general.

El desarrollo de tecnología avanzada sin una comunicación clara, accesible y honesta sobre sus límites, avances y riesgos crea desconfianza y alimenta el miedo o la desinformación. Es necesario cerrar esta brecha para fomentar un diálogo social basado en información certera y colaborativa. Asimismo, el mercado y las empresas deben involucrarse en la creación de productos con soluciones concretas y prácticas, evitando la simple puesta en marcha de modelos genéricos sin una integración adecuada con necesidades reales. La llamada «adaptación y adopción» es el verdadero cuello de botella, no solo el desarrollo teórico de modelos más potentes. En el ámbito ético y social, preocupa también el impacto medioambiental de la inteligencia artificial, especialmente el consumo energético de los grandes centros de datos que la sostienen, así como los efectos locales en comunidades que albergan estas infraestructuras o sufren la explotación minera para la obtención de materiales necesarios para fabricar hardware especializado.

La privacidad, otro tema sensible, está siendo redefinida ante el auge de sistemas que recolectan y procesan grandes volúmenes de información personal. La historia muestra que cada nuevo avance tecnológico en comunicación y procesamiento de datos ha generado debates similares sobre la privacidad, y que con el tiempo se han implementado soluciones en leyes, normas sociales y tecnologías para equilibrar beneficios y riesgos. En cuanto a la forma en que las personas interactúan con la IA, el fenómeno conocido como efecto ELIZA refleja cómo los humanos pueden proyectar emociones, intenciones o comprensión a máquinas que no las poseen. Este comportamiento es natural pero debe ser abordado mediante educación temprana y continuada, especialmente para que las nuevas generaciones desarrollen una relación crítica y consciente con estas tecnologías. Finalmente, el debate sobre si la IA «piensa» o simplemente simula procesos cognitivos sigue abierto y es, en gran medida, filosófico y lingüístico.

Los términos humanos como pensamiento, conciencia o intención no tienen equivalentes claros o medibles en los sistemas actuales, por lo que es recomendable utilizarlos con cautela para no inducir a errores conceptuales. En síntesis, cortar a través del hype de la inteligencia artificial requiere una comprensión clara de sus limitaciones, una evaluación rigurosa y una comunicación transparente y responsable. Solo así se podrá aprovechar su verdadero potencial, minimizar riesgos y construir un futuro donde la tecnología se alinee con las necesidades reales y los valores sociales. Con un enfoque crítico y bien informado, tanto científicos como usuarios, legisladores y educadores pueden contribuir a un ecosistema robusto y ético para la IA, evitando caídas en burbujas de expectativas imposibles y promoviendo avances que beneficien genuinamente a la sociedad.

![High Altitude Balloon Flights: Part 1, Basics [video]](/images/8F3F6C84-C79C-493A-9905-49ADC2B9C8D2)