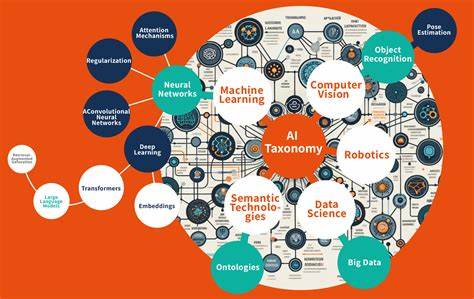

La inteligencia artificial avanza a pasos acelerados, y uno de sus mayores desafíos es la comprensión y localización precisa de objetos en entornos tridimensionales complejos del mundo real. Meta, a través de su equipo de investigación FAIR, ha presentado Locate 3D, un modelo de última generación que redefine la forma en que las máquinas entienden el espacio físico alrededor de ellas. Locate 3D se posiciona como una solución revolucionaria para aplicaciones en robótica, realidad aumentada y otras tecnologías que requieren un entendimiento profundo y dinámico del mundo 3D en tiempo real. Locate 3D permite a los sistemas inteligentes interpretar datos estándar de sensores RGB-D, ofreciendo una capacidad sin precedentes para localizar objetos usando descripciones en lenguaje natural. Por ejemplo, es posible indicarle al modelo que encuentre "una guitarra apoyada en la pared" y la IA identificará el objeto con precisión en el entorno escaneado.

Esta habilidad trasciende los métodos tradicionales basados únicamente en coordenadas o modelos 3D predefinidos, ya que incorpora una comprensión semántica y contextual que hace posible una interacción más intuitiva y flexible. El modelo opera sin necesidad de contar con información 3D precisa o "ground-truth", lo que facilita su implementación en una gran variedad de escenarios reales con sensores estándar. Esto significa que tanto robots como dispositivos de realidad aumentada podrían integrar Locate 3D para mejorar su capacidad de navegación y respuesta ante entornos cambiantes, haciendo que la inteligencia artificial sea mucho más adaptable y natural en su interacción con el espacio físico. Una de las claves del éxito de Locate 3D radica en su enfoque innovador de procesamiento, basado en tres fases principales. En primer lugar, el sistema realiza un preprocesamiento en el que las nubes de puntos capturadas por los sensores se enriquecen con características “elevadas” desde modelos fundamentales en 2D.

Esto ayuda a que el modelo aproveche la inmensa experiencia de las redes neuronales entrenadas en visión 2D para mejorar su representación visual tridimensional. Posteriormente, se construye una representación contextualizada de la escena mediante un codificador entrenado con 3D-JEPA, un algoritmo auto-supervisado desarrollado por Meta que permite la comprensión espacial profunda de nubes de puntos. 3D-JEPA trabaja prediciendo las representaciones latentes de regiones aleatoriamente enmascaradas dentro de la nube de puntos, un método que ayuda a capturar la estructura global y las relaciones espaciales del entorno evitando distraerse con información impredecible o irrelevante. Finalmente, un decodificador especializado en 3D interpreta las consultas formuladas en lenguaje natural a la vez que procesa las características obtenidas por el codificador 3D-JEPA. De este modo, Locate 3D puede responder rápidamente a comandos que requieren un razonamiento espacial avanzado y localizar objetos con precisión, incluso en entornos desafiantes y variados.

El uso de lenguaje natural como interfaz para la localización de objetos es un gran avance, pues permite que personas sin conocimientos técnicos especializados puedan interactuar con sistemas basados en IA de manera más humana e intuitiva. Que el modelo pueda entender frases subjetivas o con múltiples detalles, como "la lámpara al lado del sofá azul" o "el libro apoyado sobre la mesa de madera", abre la puerta a aplicaciones sorprendentes en hogares inteligentes y entornos industriales. Además de su potencial en robótica y realidad aumentada, Locate 3D tiene aplicaciones en áreas como la segmentación 3D, donde es crucial identificar y aislar partes de la escena para tareas específicas. También puede enriquecer el desarrollo de sistemas de respuesta a preguntas incorporadas en escenarios tridimensionales, promoviendo la interacción avanzada entre humanos y máquinas con información visual primero. Para apoyar a la comunidad investigadora y acelerar el progreso en este campo, Meta ha puesto a disposición un conjunto de datos conocido como Locate 3D Dataset.

Este dataset es una colección extensa que incluye 1,346 escenas diversas y más de 130,000 anotaciones detalladas de expresiones referenciales para entrenar y evaluar modelos que entienden espacios 3D y referencias lingüísticas complejas. Esta base representa un recurso valioso para el desarrollo de nuevas soluciones y la mejora continua de la comprensión espacial mediante IA. El compromiso de Meta con el código abierto se evidencia al liberar públicamente el modelo Locate 3D y el algoritmo 3D-JEPA, abriendo nuevas oportunidades para que investigadores, desarrolladores y empresas integren estas tecnologías en una amplia gama de productos y servicios. Esta disposición favorece la innovación colaborativa, fomentando avances que podrían marcar un antes y un después en robótica, realidad aumentada, videojuegos, y otras industrias tecnológicas. Desde una perspectiva práctica, con Locate 3D es posible imaginar un futuro donde los robots domésticos reconozcan y manipulen objetos complejos sobre la marcha, o en el que aplicaciones de realidad aumentada ofrezcan experiencias inmersivas que respondan a descripciones naturales sin necesidad de programación manual intensiva.

Las capacidades de ubicación precisa y comprensión contextual podrían usarse también en sistemas de inventario automatizados, mejora de la accesibilidad o asistencia en tareas de mantenimiento industrial. En términos de rendimiento, Locate 3D logra superar estándares previos en benchmarks de referencia referencial, demostrando una robustez excepcional y capacidad de generalización a diferentes configuraciones y ambientes interiores. Esto indica que la tecnología está preparada para afrontar los retos prácticos de instalaciones reales, lo que resulta muy prometedor para su pronta adopción comercial. La arquitectura de Locate 3D refleja el estado del arte en inteligencia artificial aplicada a la visión por computadora y comprensión del lenguaje natural. Al aprovechar lo mejor de los modelos 2D para enriquecer la información 3D y desarrollar un entendimiento contextual profundo mediante el autoaprendizaje, Meta está allanando el camino para sistemas inteligentes que interpreten el mundo tridimensional de forma más cercana a como lo hacemos los seres humanos.

![Michael Saylor Bitcoin for Corporations 2025 Keynote Speech [video]](/images/F1E65633-1948-4DAA-AEB7-B21CDD5D2DBD)