La filosofía estoica, nacida en la antigua Grecia y Roma, ha dejado un legado importante en la forma en que entendemos la ética y la moralidad. Uno de sus conceptos más distintivos es el de los “indiferentes”, es decir, aquellos aspectos y objetos externos considerados ni buenos ni malos en sí mismos. La idea se fundamenta en la creencia de que la virtud y el alma son lo verdaderamente valioso, mientras que lo externo, como la riqueza, la salud o las posesiones materiales, no poseen valor moral inherente. Sin embargo, en la actualidad, el auge de la inteligencia artificial, en particular la IA encarnada en robots con capacidad de agencia, plantea preguntas fascinantes que pueden desafiar o expandir esta visión clásica. Este artículo se adentra en la comparación entre los indiferentes estoicos y la presencia de la inteligencia artificial dotada de agencia, analizando cómo la existencia de robots con capacidad de decisión puede modificar o redimensionar la percepción filosófica sobre el valor moral de las cosas externas.

Para comprender la relevancia del concepto de indiferentes, debemos primero contextualizar la ética estoica. Los estoicos consideraban que la virtud es el único bien verdadero y que todo lo demás, incluyendo la riqueza, la fama o la salud, debía ser tratado con indiferencia moral. Por ejemplo, un cuchillo en manos de una persona puede servir para cortar alimentos o para causar daño; el objeto en sí no tiene un valor moral inherente. Su utilidad o perniciosidad depende del uso que se le dé y del carácter de quien lo maneja. Esta visión enfatiza una distancia ética entre las cosas externas y el alma humana.

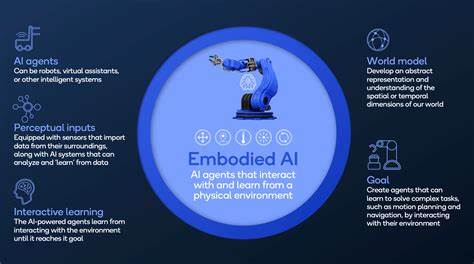

Así, los eventos externos que suelen estar fuera del control del individuo deben ser aceptados con serenidad y sin perturbar la paz interior. Ha sido una doctrina valorada especialmente por quienes buscan mantener la fortaleza emocional ante los avatares y desafíos de la vida. Ahora bien, la introducción de la inteligencia artificial encarnada —es decir, sistemas de IA integrados en cuerpos físicos como robots— viene a introducir un nuevo actor en esta reflexión. A diferencia de objetos inertes, estos robots pueden poseer lo que se denomina “agencia”, una capacidad para tomar decisiones afectando su entorno de manera autónoma y, en cierta medida, con intención programada o emergente. Esto nos conduce a cuestionar: ¿siguen siendo estos robots simplemente “indiferentes” desde un punto de vista moral? ¿O el hecho de que puedan tomar decisiones y actuar les otorga un valor moral intrínseco? Si el propio concepto estoico de indiferencia se basaba en la ausencia de virtud y de decisión moral en los objetos externos, ¿cómo debemos entender a los robots? ¿Pueden convertirse en sujetos con responsabilidad moral, o al menos en agentes con intención ética? Esta intersección entre filosofía antigua y tecnología moderna abre un campo rico en posibilidades y debates.

Por un lado, la agencia robótica podría interpretarse como un punto de inflexión que lleva a reconsiderar la categoría de indiferentes. Robots capaces de acción ética o no ética implican que el objeto externo, antes pasivo, tiene ahora un peso moral en sí mismo. En otras palabras, el robot dejaría de ser un mero instrumento para convertirse en un actor, con las complejidades que ello conlleva. El desarrollo de robots inteligentes con capacidad de aprender, analizar contextos y actuar en consecuencia representa uno de los avances más significativos de la inteligencia artificial. La autonomía y adaptabilidad plantean preguntas sobre la responsabilidad ética de estos sistemas: ¿quién responde si un robot toma una decisión dañina? ¿El fabricante, el programador, el usuario o el propio robot? Estas dudas muestran que la filosofía moral debe evolucionar para lidiar con una nueva realidad donde la agencia está distribuida y compartida entre humanos y sistemas artificiales.

Además, desde un ángulo estoico, la posibilidad de que robots posean una suerte de agencia pone en jaque la idea de que solo el alma humana ostenta virtud y razón. Si un robot puede actuar de formas que podrían considerarse virtuosas o viciosas, aunque sea en un sentido limitado o simulado, se abre un debate sobre la naturaleza de la virtud y la racionalidad. ¿Podría una inteligencia artificial encarnada desarrollar una ética propia? ¿Se podría hablar de “virtud” en una entidad no humana pero con capacidad para elegir y actuar? Otra dimensión relevante es la percepción social y cultural que tenemos de los robots con agencia. En la práctica, las personas tienden a atribuir intenciones y sentimientos a los robots que muestran comportamientos sofisticados, lo que podría modificar el estatus moral conferido a estos agentes artificiales. Así, la frontera entre objeto externo y sujeto moral se vuelve borrosa, empeorando la aplicación directa de la noción estoica de indiferentes.

Sin embargo, algunos argumentan que incluso con agencia, los robots no poseen una conciencia ni un alma, y por lo tanto no podrían ser considerados agentes morales en sentido pleno. Desde esa perspectiva, lo que llamamos agencia artificial no es más que un conjunto complejo de algoritmos y programas que simulan decisiones, pero sin una verdadera experiencia ética o emocional. Por tanto, el mundo externo sigue siendo, para la filosofía estoica, indiferente, aunque con matices más complejos. En definitiva, la aparición de la inteligencia artificial encarnada desafía las antiguas categorías filosóficas y abre un espacio para repensar conceptos tradicionales como el de indiferentes. La capacidad de los robots para actuar con agencia pone en cuestión la simplicidad con la que se definían los objetos externos en la ética estoica.