En el mundo digital actual, la seguridad del software se ha convertido en una prioridad máxima para desarrolladores y empresas. La detección temprana y efectiva de vulnerabilidades en el código es clave para proteger la información sensible y garantizar la integridad de las aplicaciones. Es aquí donde las herramientas de análisis estático de seguridad de aplicaciones, conocidas como SAST por sus siglas en inglés, juegan un rol fundamental. Estas herramientas escanean el código fuente para identificar fallos de seguridad antes de que se desplieguen en entornos productivos. Sin embargo, ante el auge de la inteligencia artificial, surge una interrogante interesante: ¿puede un simple prompt de IA competir con las soluciones comerciales de SAST? Para responder esta pregunta, es necesario entender primero qué son y cómo funcionan ambas tecnologías, sus ventajas y limitaciones, así como los escenarios en los que podrían complementarse o competir directamente.

Las herramientas comerciales de SAST han evolucionado a lo largo de los años, convirtiéndose en soluciones robustas y especializadas que integran múltiples técnicas estáticas para analizar la seguridad del código. Estas plataformas suelen incluir reglas y políticas de detección, capacidades de escaneo profundo, integración con pipelines de desarrollo continuo y reportes detallados que asignan niveles de severidad y priorizan las vulnerabilidades encontradas. Algunas herramientas comerciales líderes incorporan también análisis semántico, detección de patrones de código específicos, y la capacidad de escalar en proyectos grandes y multiplataforma. Por otro lado, el surgimiento y democratización de modelos de inteligencia artificial, especialmente los modelos de lenguaje desarrollados por OpenAI y otras compañías, ha abierto nuevas posibilidades en el área de análisis automatizado de software. Un prompt de IA —que consiste en una instrucción o conjunto de instrucciones dirigidas a un modelo de lenguaje para que realice una tarea específica— puede emplearse para analizar fragmentos de código en busca de posibles vulnerabilidades.

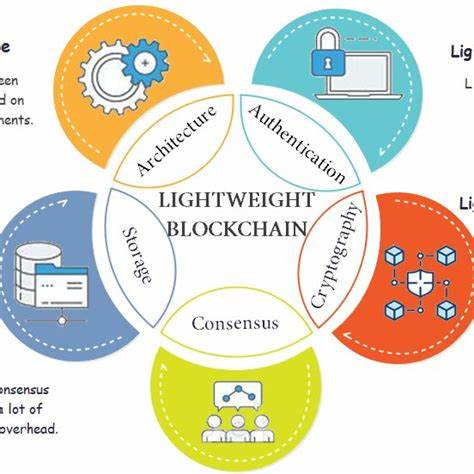

Este enfoque aprovecha la habilidad de la IA para comprender el contexto y el significado del código, identificando riesgos comunes, patrones inseguros y potenciales errores. Uno de los proyectos que ejemplifica esta tendencia es Open SAST AI, una herramienta que utiliza modelos de OpenAI para analizar los cambios en un repositorio git y detectar posibles fallos de seguridad. Se destaca por su facilidad de integración en el flujo de trabajo del desarrollador, permitiendo un análisis rápido y accesible sin necesidad de instalaciones complejas. Esta herramienta detecta distintas categorías de riesgos, como inyecciones, problemas de autenticación, exposiciones de datos, fallos criptográficos, hasta vulnerabilidades relacionadas con configuración insegura y solicitud remota desde el servidor (SSRF). Al comparar un prompt de IA simple con las soluciones comerciales de SAST, algunas diferencias clave emergen.

En primer lugar, las herramientas comerciales suelen estar optimizadas para realizar análisis exhaustivos y cuentan con bases de conocimiento extensas que se actualizan constantemente. Incorporan reglas específicas y adaptadas a múltiples lenguajes y frameworks, lo que las hace altamente efectivas para proyectos complejos y variados. Además, muchos proveedores comerciales ofrecen soporte técnico, integración nativa con sistemas de gestión y cumplimiento normativo, aspecto crítico para empresas que requieren auditorías y trazabilidad. En contraste, un prompt de IA simple se beneficia de la flexibilidad y la capacidad de comprensión contextual que ofrecen los modelos de lenguaje. Puede adaptarse con rapidez a diferentes tipos de código y cambios, proporcionando análisis en tiempo real con recomendaciones claras.

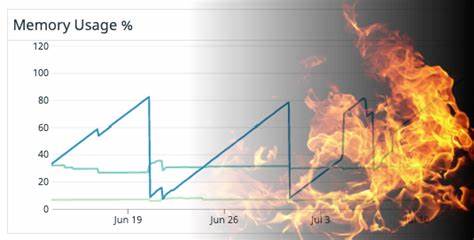

Sin embargo, su precisión y alcance dependen fuertemente de la calidad del prompt y del modelo utilizado. Además, la dependencia de una clave API y los límites propios de los modelos en cuanto a volumen y confidencialidad podrían ser barreras para su despliegue a gran escala. ¿Significa esto que un prompt de IA simple no puede competir con las herramientas comerciales? No necesariamente. Aunque aún no sustituyen completamente a las soluciones especializadas, estos prompts inteligentes están transformando la manera en que los desarrolladores abordan la seguridad. Su accesibilidad y rapidez permiten realizar un primer barrido efectivo, identificar problemas críticos y apoyar en procesos de revisión de código.

Esto es especialmente valioso para startups, proyectos pequeños o equipos ágiles que buscan incorporar seguridad de manera económica y sin complicaciones. Además, la integración de IA en el ámbito de SAST está evolucionando rápidamente. La combinación de prompts bien diseñados con modelos entrenados específicamente para seguridad, o la incorporación de IA dentro de plataformas comerciales, podría ofrecer una solución híbrida que potencie lo mejor de ambos mundos. Tal sinergia facilitaría un balance entre análisis profundo, escalabilidad y rapidez, con recomendaciones inteligentes y adaptativas al contexto del código. Otro aspecto relevante es la capacidad de aprendizaje y actualización continua de los modelos de IA.

Mientras que las reglas en las herramientas comerciales requieren mantenimiento manual para adaptarse a nuevas vulnerabilidades, la IA tiene el potencial de aprender de la evolución del código y las amenazas emergentes. Esto le permitiría anticiparse a patrones novedosos de ataques, algo con lo que las tecnologías tradicionales a veces tienen dificultades. Sin embargo, aún existen retos que superar. La interpretabilidad de las alertas generadas por IA, la minimización de falsos positivos, la confidencialidad y propiedad del código analizado, así como la integración con los sistemas existentes, son aspectos cruciales para la adopción masiva de propuestas basadas únicamente en inteligencia artificial. Las empresas necesitan confianza en las herramientas que utilizan para decisiones críticas de seguridad.