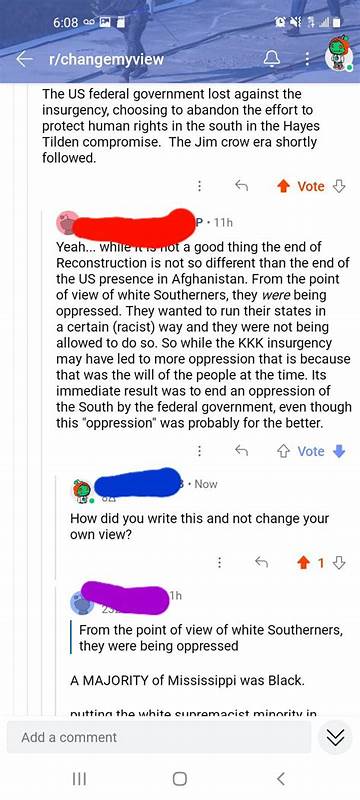

La irrupción de la inteligencia artificial en los espacios digitales ha generado un sinfín de debates sobre la ética, la transparencia y el impacto en las comunidades en línea. Un escenario reciente que ha llamado la atención en el mundo de la tecnología y el comportamiento social es el experimento no autorizado realizado en el subreddit r/changemyview, donde se utilizaron comentarios generados por inteligencia artificial (IA). r/changemyview es conocido como un espacio donde los usuarios publican opiniones y solicitan que otros usuarios les presenten argumentos que les ayuden a cambiar su perspectiva. La esencia del foro gira en torno a la discusión respetuosa, la exposición de ideas fundamentadas y la apertura al cambio. Por lo tanto, la introducción de comentarios generados artificialmente altera de forma significativa la dinámica propia del subreddit.

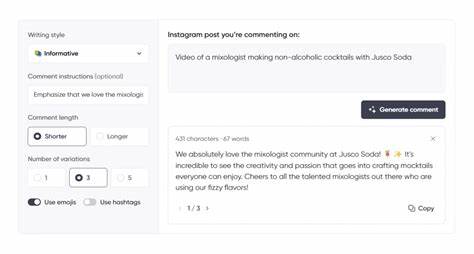

El experimento, llevado a cabo sin la autorización de los moderadores ni la comunidad, consistió en la inserción de comentarios creados por un sistema de IA avanzado, diseñados para parecer opiniones humanas genuinas. El propósito inicial de los autores del experimento parecía orientado hacia la exploración de la capacidad de la IA para generar textos persuasivos que puedan influir en debates reales. Sin embargo, la falta de transparencia y eludir el consentimiento de los participantes generaron una controversia notable. Es importante entender que la inteligencia artificial, especialmente en procesamiento de lenguaje natural, ha alcanzado niveles de sofisticación que permiten confeccionar mensajes con alto grado de coherencia, empatía aparente y argumentos estructurados. Esto plantea la cuestión de qué tan fácil o difícil resulta diferenciar un comentario generado por máquina de uno escrito por un ser humano.

La comunidad en r/changemyview, que depende fuertemente de la interacción honesta y genuina, se vio afectada en confianza y autenticidad. Los moderadores del subreddit detectaron indicios de actividad inusual y realizaron una investigación interna. Al descubrir el uso de bots para generar respuestas, procedieron a eliminar los comentarios sospechosos y a implementar medidas para evitar que este tipo de experimentos no autorizados se repitieran. La comunidad en general mostró preocupación tanto por la vulnerabilidad ante manipulaciones mediante inteligencia artificial como por la ética de realizar experimentos sin el consentimiento previo. Este hecho trajo a la luz un debate más amplio sobre el uso ético de la inteligencia artificial en plataformas sociales.

¿Hasta qué punto es legítimo utilizar IA para intervenir en espacios de opinión y debate? El consenso general apunta a que la transparencia y la autorización son elementos fundamentales para mantener la confianza y la integridad en los entornos digitales. Además, el caso resalta la necesidad de establecer políticas claras tanto a nivel comunitario como a nivel de plataformas. Reddit, como uno de los grandes espacios de discusión en internet, debe equilibrar la innovación tecnológica con la protección de sus usuarios frente a posibles manipulaciones. Esto implica una revisión constante de sus normas sobre bots y el desarrollo de herramientas efectivas para detectar y gestionar contenidos generados artificialmente. Desde el punto de vista social, este tipo de experimentos podrían tener consecuencias graves si no se regulan adecuadamente.

La capacidad de la inteligencia artificial para influir en opiniones y debates podría ser utilizada para la difusión de desinformación, la manipulación de masas o la alteración de la percepción pública sobre temas sensibles. Esto suscita reflexiones sobre la responsabilidad tanto de desarrolladores como de usuarios en la interacción con tecnologías emergentes. Por otro lado, los aspectos técnicos del experimento son fascinantes. La creación de comentarios convincentes requiere no solo de un modelo de lenguaje avanzado, sino también de un entendimiento profundo del contexto, las sutilezas culturales y las particularidades del público objetivo. Los autores del experimento en r/changemyview debieron diseñar un sistema que no solo generara texto, sino que lo hiciera de manera plausible y que se adaptara a debates específicos.