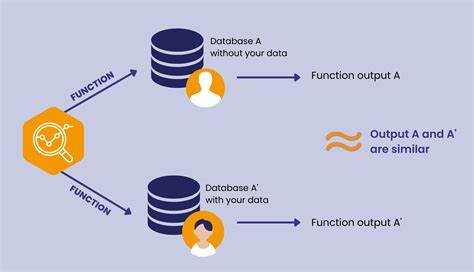

En la era digital actual, la protección de los datos personales se ha convertido en uno de los temas más críticos y debatidos en el ámbito tecnológico y social. Con el aumento exponencial del intercambio de información en internet, surge la necesidad imperiosa de garantizar que los datos sensibles de los usuarios permanezcan resguardados ante posibles usos indebidos. La privacidad diferencial es una metodología innovadora que ha ganado gran reconocimiento como el estándar oro para preservar la confidencialidad en el procesamiento de datos estadísticos. La privacidad diferencial, a menudo mencionada en inglés como Differential Privacy, es una técnica que introduce ruido estadístico cuidadosamente calibrado en los conjuntos de datos o en los procesos que consultan dichos datos. El propósito principal de esta introducción de aleatoriedad es impedir que, a partir del análisis de la información agregada, un atacante pueda reconstruir o inferir con certeza datos personales específicos.

En otras palabras, esta metodología permite extraer conclusiones útiles y generales sobre un conjunto de datos sin comprometer la privacidad individual de quienes forman parte de él. Esta práctica es especialmente valiosa en contextos en los que se manejan grandes volúmenes de datos sensibles, como en la salud pública, investigación académica o en el análisis de comportamiento en línea. Compañías reconocidas como Google, Apple y Microsoft han incorporado la privacidad diferencial en sus productos y servicios para mejorar la seguridad de los usuarios. Paralelamente, el Censo de los Estados Unidos de 2020 representó un hito destacado al utilizar esta tecnología para proteger la información recolectada de millones de ciudadanos. La creciente adopción de la privacidad diferencial no está exenta de debate.

Algunos sectores cuestionan su precisión y su impacto en la calidad de los datos, debido a la alteración introducida por el ruido estadístico. Sin embargo, el consenso general indica que es una solución potentemente equilibrada para resguardar la privacidad sin sacrificar el valor informativo de los datos. El origen de la privacidad diferencial se remonta a principios de la década de 2000 y estuvo motivado por la preocupación creciente respecto a las técnicas tradicionales de anonimización o desidentificación de datos. Estos métodos clásicos, basados en eliminar o enmascarar identificadores directos como nombres o números de identificación, demostraron ser insuficientes cuando los datos combinados con otras fuentes externas podían permitir la reidentificación de individuos. Situaciones como estos han evidenciado la necesidad de métodos más sólidos y matemáticamente fundamentados para proteger la privacidad.

Así, la privacidad diferencial ofrece garantías probabilísticas que aseguran que la inclusión o exclusión de un solo individuo en un conjunto de datos no afectará significativamente los resultados de un análisis estadístico. Esta característica se traduce en un nivel de protección cuantificable y ajustable según los requisitos de privacidad y precisión de cada caso específico. Uno de los aspectos que hacen que la privacidad diferencial sea innovadora y eficiente es su fundamento en la teoría matemática. Esta base científica permite definir y medir de manera clara qué tan confidencial es la información que se protege y cuál es el margen de error aceptable en las consultas a los conjuntos de datos. La clave está en encontrar un equilibrio óptimo entre privacidad y utilidad, una tarea compleja que exige un análisis cuidadoso de los parámetros que controlan la cantidad de ruido introducido.

En aplicaciones prácticas, la privacidad diferencial se ha utilizado en múltiples ámbitos. En el sector tecnológico, artistas como Apple han integrado esta técnica para recopilar datos de uso con fines de mejora de productos sin vulnerar la privacidad del usuario final. Google, a su vez, aplica privacidad diferencial en su plataforma de estadísticas y publicidad para ofrecer datos de comportamiento sin exponer la información individual. En la administración pública, un caso emblemático fue el empleo por primera vez masiva de la privacidad diferencial durante el censo norteamericano del 2020. Este proceso, vital para la distribución de recursos y la representación política, implicaba la recopilación de datos demográficos detallados de millones de personas.

La implementación de privacidad diferencial permitió que se publicaran estadísticas precisas y útiles sin comprometer la privacidad de los participantes. Aunque generó polémicas y debates sobre la precisión de los datos, la experiencia sentó un precedente para otros organismos internacionales. La privacidad diferencial también encuentra aplicación en la salud, donde la confidencialidad es fundamental. En estudios epidemiológicos o investigaciones de mercado en salud, la capacidad de analizar datos agregados sin revelar información personal aumenta la confianza del público y facilita la colaboración entre entidades. Igualmente, en el campo académico y la investigación científica, esta técnica permite compartir datos para fines analíticos sin poner en riesgo la identidad o datos sensibles de individuos.

A pesar de sus muchas ventajas, la privacidad diferencial tiene limitaciones que deben considerarse. Por ejemplo, la incorporación de ruido puede afectar la precisión de los resultados y, en algunos casos, dificultar el uso de ciertos análisis estadísticos o modelos de aprendizaje automático. Además, la implementación requería un conocimiento profundo y una adecuada calibración de parámetros para asegurar que tanto la privacidad como la utilidad sean óptimas. Otro reto importante reside en la aceptación social y política. La privacidad diferencial es un concepto relativamente nuevo y técnico, lo que puede generar desconfianza o resistencia entre usuarios, legisladores y organismos reguladores.

La transparencia, la educación y la comunicación efectiva son fundamentales para superar estos obstáculos y fomentar su adopción generalizada. En comparación con otras estrategias tradicionales como la anonimización simple, la privacidad diferencial ofrece mayor solidez y seguridad frente a ataques complejos. Métodos antiguos como la eliminación de identificadores fueron superados por técnicas modernas de reidentificación que combinaban múltiples fuentes de datos. Además, estrategias como k-anonimato, otro enfoque para preservar privacidad, se han visto vulnerables en ciertos escenarios. En contraste, la privacidad diferencial proporciona garantías matemáticas formales que no dependen únicamente de la supresión o el enmascaramiento de datos.

El futuro de la privacidad diferencial parece prometedor y clave para el desarrollo de tecnologías responsables y éticas. A medida que el volumen de datos generados y compartidos continúa creciendo, será imprescindible contar con herramientas avanzadas que protejan la privacidad sin obstaculizar la innovación. La regulación y las políticas públicas también tendrán un papel fundamental en establecer marcos que incentiven el uso de estas metodologías y protejan los derechos de los ciudadanos. La privacidad diferencial abre la puerta a una nueva era en la gestión de datos personales, donde la protección y el aprovechamiento de la información pueden coexistir de manera equilibrada. Desde las grandes corporaciones tecnológicas hasta las instituciones gubernamentales y el mundo académico, la incorporación de este enfoque muestra un compromiso creciente con la ética en el manejo de datos.

En conclusión, la privacidad diferencial representa un avance significativo en el campo de la seguridad y la protección de datos personales. Su fundamento matemático, su aplicación en contextos reales y la aceptación creciente en múltiples sectores la posicionan como la mejor alternativa para asegurar que el manejo de información sensible respete la confidencialidad de quienes la generan. Aunque enfrenta desafíos en su implementación y percepción pública, su potencial para transformar la forma en que entendemos la privacidad en la era digital es inmenso y crucial para un futuro donde la tecnología y los derechos individuales convivan en armonía.