En la última década, la inteligencia artificial (IA) se ha convertido en una tecnología clave que transforma múltiples industrias, siendo Google uno de sus principales actores a nivel global. La empresa ha potenciado sus servicios con la incorporación de herramientas de IA avanzadas, cuyos modelos necesitan cantidades masivas de datos para su entrenamiento y optimización. Sin embargo, un fenómeno que está ganando relevancia y ocasionando controversias es el uso de contenido web para entrenar estos modelos, incluso cuando los creadores de ese contenido han decidido no permitir su utilización, mediante mecanismos de exclusión conocidos como opt-out. Recientemente, una declaración emitida por un vicepresidente de producto de Google DeepMind, la división de IA de la compañía, ha evidenciado que los controles establecidos para que los editores puedan proteger su contenido y evitar que sea utilizado para entrenar modelos de inteligencia artificial solo aplican al trabajo específico desarrollado por DeepMind. Esto implica que otras áreas o productos dentro de Google podrían continuar empleando esos mismos datos, desafiando la intención de los propietarios del contenido de mantener su obra fuera del ciclo de entrenamiento.

Este escenario ha generado un debate importante en los ámbitos legales, tecnológicos y éticos. Por un lado, los creadores y propietarios de sitios web tienen derecho a decidir cómo se utiliza su contenido, especialmente cuando este tiene valor comercial o informativo. Por otro lado, la industria tecnológica, y en particular Google, argumenta que su modelo de negocio y desarrollo tecnológico depende de la recopilación y análisis de grandes volúmenes de información públicas para mejorar la calidad de sus sistemas y la experiencia del usuario final. El contexto de la inteligencia artificial y sus necesidades de datos es esencial para comprender la magnitud del debate. Los sistemas de procesamiento del lenguaje natural, búsquedas avanzadas y generación de texto —entre otros— requieren modelos entrenados con conjuntos de datos amplios y diversos para funcionar correctamente.

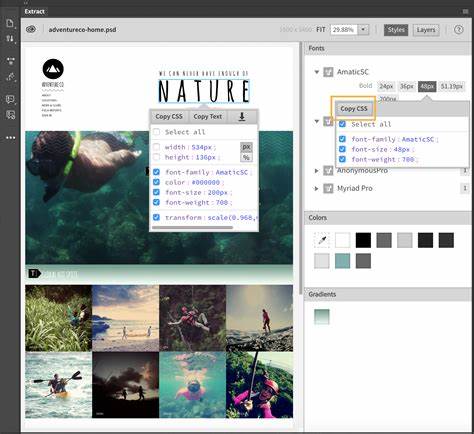

Esto implica acceder a miles de millones de páginas, documentos, artículos y otras fuentes de información disponibles en Internet. Sin embargo, las políticas de exclusión generalmente permiten a los propietarios de esos contenidos manifestar su voluntad de no ser incluidos en bases de datos usadas para el entrenamiento. Google, como líder en la industria, ha adoptado ciertas medidas para respetar algunas de estas solicitudes de exclusión a nivel de DeepMind, pero la realidad que planteó su vicepresidencia indica que esta protección no es integral ni universal. Las diferentes divisiones dentro de la compañía pueden utilizar libremente el contenido web para alimentar sus propios modelos de IA, sin ofrecer un mecanismo automático que respete el opt-out solicitado por los creadores. Este hecho ha sido señalado en audiencias y demandas, donde se cuestiona si Google está respetando las normativas existentes sobre propiedad intelectual, derechos de autor y privacidad.

La capacidad de una empresa con tanto poder y alcance para acceder y aprovechar contenido sin consentimiento claro podría sentar precedentes de implicaciones significativas para el futuro digital. Desde una perspectiva económica, los sitios web que generan contenido original enfrentan el riesgo de que su trabajo sea utilizado como materia prima para mejorar productos de una empresa que no compensa ni reconoce directamente su contribución. Esto puede romper el equilibrio en el ecosistema digital, afectando a periodistas, bloggers, autores y medios que dependen de la monetización basada en sus contenidos. Además, la transparencia en la utilización de datos es cada vez más demandada por usuarios, reguladores y gobiernos. La incertidumbre sobre el uso que Google hace de la información recopilada alimenta el escepticismo y contribuye a un creciente sentimiento de que las grandes empresas tecnológicas deben ser sometidas a controles legales más estrictos.

En algunos países, estas regulaciones ya están en proceso o planificación, buscando proteger tanto a los creadores individuales como a la sociedad en general. El impacto en la innovación también es un tema candente. Mientras que un acceso libre y amplio a información puede acelerar avances en IA y tecnologías asociadas, la falta de respeto por derechos fundamentales puede inhibir la creación de contenido de calidad y la participación activa de comunidades creativas, lo que a largo plazo podría limitar el desarrollo tecnológico sostenible y equitativo. En el ámbito del usuario común, la mejora de las funcionalidades basadas en IA —como resúmenes automáticos, respuestas más precisas o recomendaciones personalizadas— puede beneficiar la experiencia digital. Sin embargo, este avance no debería estar reñido con la ética ni con el cumplimiento legal, aspecto que Google debe equilibrar cuidadosamente para evitar sanciones y preservar su prestigio.