La irrupción de la inteligencia artificial generativa ha marcado un antes y un después en múltiples industrias. Desde su aparición, herramientas como ChatGPT han revolucionado la manera en que las empresas abordan la automatización, la gestión del conocimiento y la eficiencia operativa. Sin embargo, no todas las organizaciones han adoptado esta tecnología con rapidez; algunas han optado por una postura más prudente y reflexiva. Un claro ejemplo es Limbach Company, líder en servicios de construcción y edificación, cuya estrategia para implementar la IA generativa se ha caracterizado por la cautela y un enfoque basado en la seguridad y la confianza. El responsable de definir esta estrategia ha sido Christos Ruci, el director de información (CIO) de Limbach.

Cuando ChatGPT debutó a finales de 2022, Ruci tuvo una reacción inmediata que fue un rotundo “no”. Aunque normalmente su personalidad es proactiva, orientada a experimentar y aprender mediante el ensayo y error, en esta ocasión priorizó la seguridad de los datos de sus empleados y clientes por encima de cualquier posible beneficio inmediato. Para él, la posibilidad de una fuga de datos sensibles planteaba riesgos demasiado altos que podrían comprometer la confianza dentro y fuera de la organización, además de dañar su reputación profesional. Limbach, con sus 1,400 empleados, es una compañía con un volumen significativo de información delicada, desde datos personales hasta información corporativa estratégica. Por esta razón, Ruci decidió bloquear todas las aplicaciones de IA generativa a nivel interno durante más de dos años, lo que puede parecer un acto conservador en una época donde las inversiones en IA superan miles de millones de dólares a nivel global y casi siete de cada diez empresas adoptan estas tecnologías en alguna función.

La preocupación principal era evitar cualquier exposición no intencionada de datos críticos. Los riesgos asociados a la transferencia de información privada o confidencial a plataformas externas pueden traducirse en brechas de seguridad, daño reputacional y pérdida de confianza. En sectores como los servicios de construcción, donde la confidencialidad y la integridad de los proyectos son básicos, la prudencia de Ruci fue crucial para mantener la integridad operativa. A lo largo del tiempo, la postura de Limbach no fue simplemente de bloqueo pasivo. Por el contrario, el equipo de TI bajo la dirección de Ruci trabajó incansablemente en la formación y educación constante de la plantilla.

La experiencia en ciberseguridad y en prevenir ataques digitales se convirtió en el modelo ideal para abordar la futura implementación de IA generativa. Mediante webinars, reuniones generales y conversaciones personalizadas con cada unidad de negocio, los empleados fueron familiarizándose con las posibles ventajas y, sobre todo, con las limitaciones y normativas internas relacionadas con el uso de estas herramientas. En paralelo, el departamento legal y de cumplimiento normativo colaboró estrechamente para diseñar un marco claro sobre qué se podía y qué no se podía hacer con herramientas de inteligencia artificial generativa. Se hicieron explícitas prohibiciones sobre la utilización de datos personales, información financiera no pública y cualquier dato relativo a clientes, proyectos, propiedad intelectual o secretos comerciales dentro del entorno de IA generativa. Esta regulación minuciosa busca proteger a la empresa y a sus stakeholders de riesgos internos y externos.

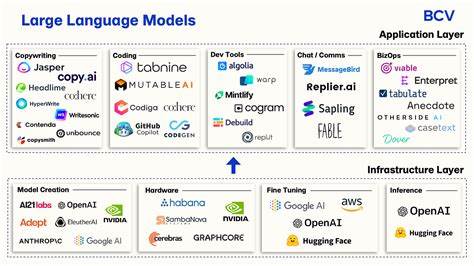

Finalmente, en este año, después de evaluar minuciosamente las condiciones y tras sentar las bases necesarias para un uso responsable, la dirección autorizó el acceso controlado a este tipo de herramientas por parte de los empleados. La incorporación es limitada y supervisada, utilizando los recursos de OpenAI, Microsoft y Google, con la premisa fundamental de mejorar la productividad, priorizando funciones como la transcripción automática de reuniones para facilitar resúmenes y revisiones rápidas. A pesar de esta apertura, todavía existen áreas donde la inteligencia artificial generativa no ha sido adoptada completamente. Limbach no permite que los datos críticos, como información médica, financiera o de clientes, sean procesados por IA. Tampoco se utiliza para gestionar procesos sensibles como renuevos contractuales automatizados o la recuperación avanzada de datos, aunque estas aplicaciones se consideran para el futuro cercano.