En la actualidad, la tecnología juega un papel fundamental en la relación entre la sociedad y las fuerzas del orden. La adopción de inteligencia artificial (IA) en las tácticas policiales ha generado un debate intenso sobre su uso ético y el impacto que puede tener en la privacidad y los derechos humanos. Dentro de este contexto, el efecto Streisand emerge como un fenómeno crucial para entender cómo las acciones de las autoridades pueden, en lugar de ocultar información o controlar situaciones, terminar por alimentarlas y amplificarlas involuntariamente. El efecto Streisand se refiere a la paradoja en la cual un intento de censurar, eliminar o controlar cierta información provoca un mayor interés público y distribución de dicha información. En el caso de la aplicación policial, este fenómeno puede presentarse cuando las autoridades intentan ocultar o minimizar la visibilidad de ciertas conductas o grupos, pero su intervención o reacción provoca que estas situaciones reciban una atención mediática y popular mucho mayor.

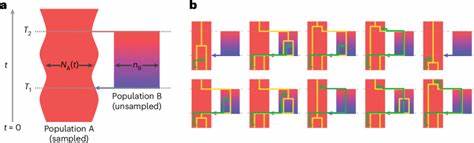

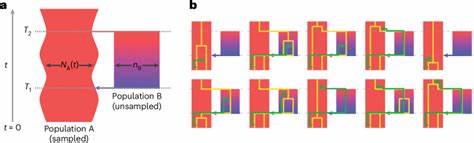

La integración de inteligencia artificial por parte de las fuerzas policiales puede ser un doble filo. Por un lado, la IA tiene el potencial de mejorar la eficiencia operativa, facilitando la identificación de patrones de comportamiento delictivo y apoyando en tareas de seguridad pública. Sin embargo, cuando se utiliza con técnicas que buscan provocar conductas específicas o incluso fomentar la trampa y el engaño para justificar arrestos, la IA puede convertirse en una herramienta peligrosa para la manipulación y violación de derechos. La existencia de sistemas basados en inteligencia artificial que actúan con estrategias de máxima provocación y entrapment (entrampamiento) ha sido materia de preocupación y controversia. Estos sistemas pueden analizar datos masivos para predecir comportamientos y, en algunos casos, intervenir activamente para generar situaciones en las que individuos sean inducidos a cometer actos susceptibles de ser penados legalmente.

Más allá de la mera vigilancia, la IA puede transformar la prevención del delito en un mecanismo de persecución preventiva o injusta. Esta distorsión en el uso de tecnologías inteligentes por las fuerzas del orden vulnera principios fundamentales del derecho penal, como la presunción de inocencia y el debido proceso. La provocación activa, especialmente asistida por software de inteligencia artificial, puede constituir una forma de manipulación indecente que afecta la confianza ciudadana y desdibuja la frontera entre prevención y abuso de poder. La irradiación del efecto Streisand en esta dinámica contribuye a un efecto boomerang sobre las mismas fuerzas del orden. La exposición y difusión de prácticas cuestionables de vigilancia y provocación policial se amplifican a través de redes sociales y plataformas digitales.

Lo que se intenta controlar o reducir se vuelve viral, generando un debate público intenso sobre la ética, la legalidad y la necesidad de regulación estricta de las tecnologías de IA en seguridad. Es fundamental comprender los mecanismos mediante los cuales la IA, combinada con el efecto Streisand, altera el actuar policial y su percepción social. Esta fusión puede facilitar la creación de trampas intelectuales y tecnológicas destinadas a capturar no solo delincuentes sino también a ciudadanos inocentes, quienes podrían ser objeto de provocaciones deliberadas para justificar intervenciones legales. Además, la falta de transparencia en el diseño y aplicación de estas herramientas de inteligencia artificial dificulta la supervisión efectiva. Sin un escrutinio adecuado, la línea entre prevención legítima y provocación artificial se difumina, poniendo en riesgo garantías esenciales para la convivencia democrática.

Por otra parte, la respuesta de la sociedad ante estas prácticas tiene un componente revitalizador gracias al efecto Streisand. Al difundirse testimonios, denuncias y pruebas, la ciudadanía se moviliza para exigir mayor responsabilidad y regulación en el uso de IA por parte de cuerpos policiales. La presión pública puede impulsar reformas y una mayor supervisión tecnológica para evitar abusos. En suma, la convergencia entre el efecto Streisand y la inteligencia artificial utilizada por agentes policiales para provocar y atrapar personas genera un escenario complejo. Los riesgos asociados a la manipulación inducida de comportamientos y la viralización de la información suprimida o controlada demandan un análisis profundo y políticas claras.

Con la expansión de la vigilancia tecnológica y algoritmos sofisticados, el desafío consiste en equilibrar la seguridad pública con la protección de derechos y libertades fundamentales. La transparencia en el desarrollo de IA, la regulación estricta de su uso en fuerza pública y la participación ciudadana activa son piezas clave para evitar que estas herramientas se conviertan en instrumentos de abuso. La inteligencia artificial dentro de la policía no debe ser sinónimo de provocación ni de trampa, sino un recurso que refuerce la justicia y la protección ciudadana. Mientras tanto, el efecto Streisand sigue recordándonos que en nuestra era digital intentar ocultar o manipular información puede desencadenar resultados inesperados que, aunque difíciles de controlar, pueden convertirse en un motor de cambio social y político. Este nuevo panorama obliga a repensar la relación entre tecnología y poder.

La vigilancia algorítmica, si bien puede traer beneficios en la prevención del delito, debe regirse por principios éticos claros para evitar caer en prácticas que atenten contra la dignidad humana y el respeto a los procesos judiciales. La transparencia, la supervisión independiente y el debate público son herramientas fundamentales para garantizar que la IA en la policía se utilice con responsabilidad y humanidad. En definitiva, mirar críticamente el uso de inteligencia artificial para provocación extrema y entrapment policial, junto con la comprensión del efecto Streisand, es indispensable para construir sociedades más justas y conscientes de los riesgos tecnológicos. La protección de los derechos civiles y la integridad de las personas deben primar en cualquier aplicación tecnológica, especialmente en ámbitos tan sensibles como la seguridad y el orden público.