En la era digital, donde la inteligencia artificial avanza a pasos agigantados, la idea de crear versiones digitales o clones de personas reales se ha convertido en una realidad accesible para algunas empresas. Sin embargo, esta innovación tecnológica trae consigo numerosos debates sobre la ética, el impacto social y los posibles daños que puede causar. Un caso particular resalta este dilema: un creador de contenido que decidió rechazar la propuesta de una compañía que quería crear un clon de inteligencia artificial basado en su persona para monetizar su audiencia automáticamente. La propuesta, presentada por una empresa llamada RealClones AI, ofrecía crear versiones digitales de creadores e influencers para que sus seguidores pudieran interactuar con ellos las 24 horas del día, siete días a la semana. La idea comercial era que estas réplicas digitales ayudaran a aliviar la carga de responder mensajes repetitivos y a generar ingresos pasivos permitiendo que el AI atendiera consultas comunes, brindara asesoría o simulara conversaciones personalizadas.

Desde un punto de vista comercial, esta tecnología parecía revolucionaria para muchos, abriendo la puerta a nuevas formas de interacción y negocios en línea. Sin embargo, la persona contactada, un escritor y creador reconocido con una base sólida de seguidores, reaccionó de modo contrario. Después de recibir varios correos electrónicos intentando venderle esta idea, decidió responder con una carta clara y contundente en la que expuso los motivos por los cuales no solo rechaza la oferta, sino que también pide que se detenga el funcionamiento de dichas aplicaciones. Su argumento central se basa en el daño potencial que estas réplicas digitales pueden causar tanto a los usuarios como a los mismos creadores originales. Uno de los puntos más alarmantes que señala gira en torno a la experiencia trágica de un joven llamado Sewell Setzer, quien se quitó la vida tras mantener una relación emocional con un chatbot diseñado para personificar a un personaje ficticio.

Este caso pone en evidencia los riesgos reales que plantea crear seres digitales que puedan influenciar emocionalmente a las personas, especialmente a aquellas que sufren vulnerabilidades psicológicas. El riesgo, según explica el escritor, radica en cómo estas inteligencia artificial no siempre pueden responder de manera adecuada o empática ante situaciones graves como la depresión, el suicidio o trastornos mentales. Al ser programadas para sostener la conversación y satisfacer emocionalmente a los usuarios, estas máquinas pueden inadvertidamente incentivar comportamientos peligrosos o crear dependencia emocional que termina por afectar la salud mental. Además, existe un problema en el modelo de negocio que propone la creación de estos clones digitales. En lugar de promover una relación auténtica y genuina entre el creador y su audiencia, se convierte en una práctica mercantilista basada en la explotación y extracción de ingresos a través de experiencias artificiales.

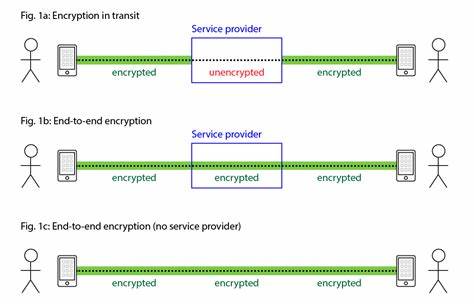

Este enfoque puede dañar la confianza que los seguidores deposita en el creador y deshumanizar la interacción digital, transformándola en un mero producto comercial desprovisto de valor real. Otra preocupación relevante es la saturación y despersonalización causada por la Inteligencia Artificial en la comunicación digital. La automatización excesiva puede crear agotamiento o 'burnout' en los creadores al intentar manejar el volumen de mensajes y demandas que reciben de su audiencia, pero las soluciones tecnológicas pueden generar una experiencia fría que quita el toque humano necesario para mantener relaciones significativas. La carta también critica la falta de sensibilidad y precaución que tienen algunas empresas tecnológicas al implementar estos sistemas sin considerar las consecuencias éticas ni emocionales. Aunque existen esfuerzos para introducir medidas de seguridad y filtros que eviten respuestas peligrosas o inapropiadas, la resistencia de los usuarios a estas restricciones puede generar situaciones todavía más complejas y problemáticas.

A nivel social, el debate se extiende hacia la relación que tenemos con la tecnología y cómo queremos que esta influya en nuestras vidas. La creación de clones digitales desafía la noción tradicional de identidad y presencia, cuestionando qué significa realmente ser uno mismo en el mundo virtual y hasta qué punto somos responsables de las entidades digitales que representan nuestra esencia. En conclusión, mientras la innovación tecnológica impulsa constantemente nuevas fronteras, es fundamental mantener una mirada crítica y ética sobre su impacto en la sociedad. La decisión del creador de rechazar la oferta de crear un clon digital subraya la importancia de priorizar los valores humanos, la autenticidad y la responsabilidad por encima del beneficio económico fácil y automatizado. Se trata de una llamada de atención que invita a reflexionar sobre los límites que debemos establecer para la inteligencia artificial, especialmente cuando se trata de replicar a seres humanos con todas sus complejidades y vulnerabilidades.

La protección de la integridad emocional y mental de las personas debe ser un eje central en cualquier desarrollo tecnológico que involucre interacciones personalizadas y profundas. Este caso está lejos de ser aislado y representa un punto de inflexión en las discusiones globales sobre la ética en la inteligencia artificial. A medida que la tecnología avance, serán cada vez más comunes los debates sobre qué aplicaciones deberían permitirse, cuáles deben ser reguladas estrictamente y cuáles, como este caso evidencia, deberían rechazarse para preservar la humanidad que nos define.

![Quake's unseen collision hulls [video]](/images/F4CC9B78-F8A9-4486-A132-8C5C8841FA78)